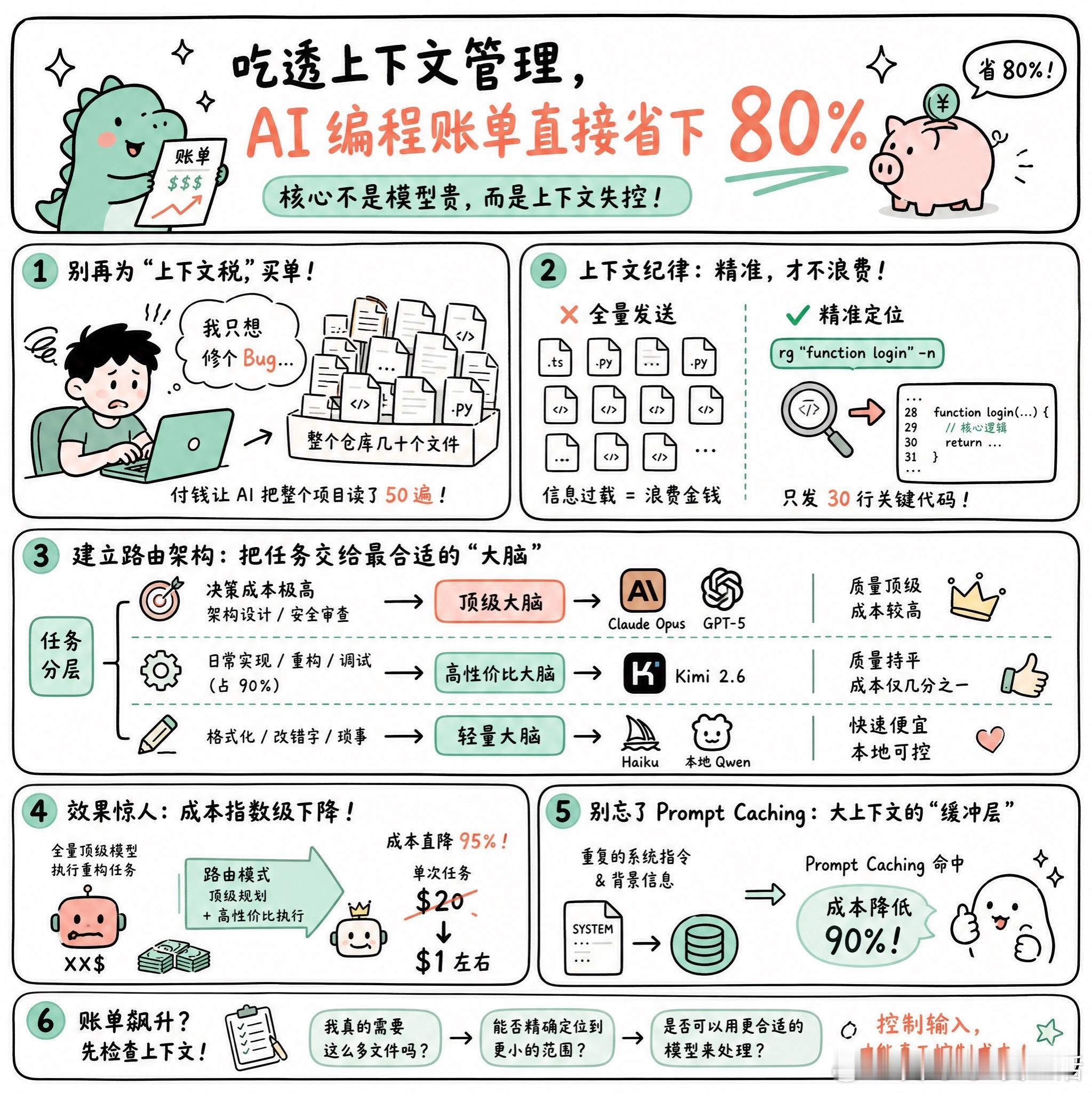

【吃透上下文管理,AI编程账单直接省下80%】

快速阅读:本文揭示了 AI 编程费用激增的本质并非模型太贵,而是上下文管理的失控。通过建立多模型路由架构、实施上下文纪律以及利用缓存技术,开发者可以在不损失交付质量的前提下,将月度账单降低 80% 以上。

很多人觉得 AI 编程越来越贵,是因为模型进化了,或者是 Agent 消耗了太多 Token。其实这更像是一种“上下文税”。当你在 Cursor 或 Claude Code 里随手一问,系统为了“保险”往往会把整个仓库的几十个文件全塞进上下文。你以为在让 AI 帮你修 Bug,实际上你是在付钱让它把整个项目重新读上五十遍。

真正的省钱逻辑不在于更换更便宜的模型,而在于控制输入。

有观点认为,很多人陷入了“全量发送”的陷阱:为了防止 AI 缺失信息,习惯性地把所有相关的 `.ts` 或 `.py` 文件全丢进去。这就像为了修一个水龙头,却把整栋楼的图纸都打印出来交给工人。解决办法很简单:先用 `grep` 或 `ripgrep` 精确定位,只把那 30 行关键代码发给模型。

更核心的变革在于建立一套“路由架构”。不要试图用一个模型解决所有问题。

把任务分层:架构设计、安全审查这种“决策成本极高”的任务,留给 Claude Opus 或 GPT-5 这种顶级大脑;而 90% 的日常实现、重构和调试,Kimi 2.6 这种性价比极高的模型就能做到质量持平,成本却只有几分之一。至于格式化、改错字这种琐事,交给 Haiku 或者本地运行的 Qwen 即可。

有网友提到,这种分层逻辑能让 Agentic 工作流的成本呈指数级下降。当一个复杂的重构任务从全量使用顶级模型转变为“顶级模型规划 + 高性价比模型执行”时,单次任务的成本能从 20 美元降到 1 美元左右。

最后,别忘了 Prompt Caching。它是你应对大规模上下文的“缓冲层”,能让重复的系统指令成本降低 90%。

如果你发现自己的 AI 账单在飙升,先停下来看一眼你的上下文里有多少是冗余的。

x.com/DeRonin_/status/2054235707791778034