医学AI是否真的靠谱?这个看似简单的问题,其实一直困扰着整个人工智能领域。当我们把生命健康交给AI助手时,如何确保它们给出的建议真的安全可靠?来自宾夕法尼亚州利哈伊大学、哈佛大学、帝国理工学院以及麻省总医院的研究团队,在2025年2月发表了一项重要研究成果,该论文发表在Conference'17会议上,论文编号为arXiv:2602.10367v1。这项研究首次揭露了现有医学AI评测体系的致命缺陷,并提出了一套革命性的解决方案。

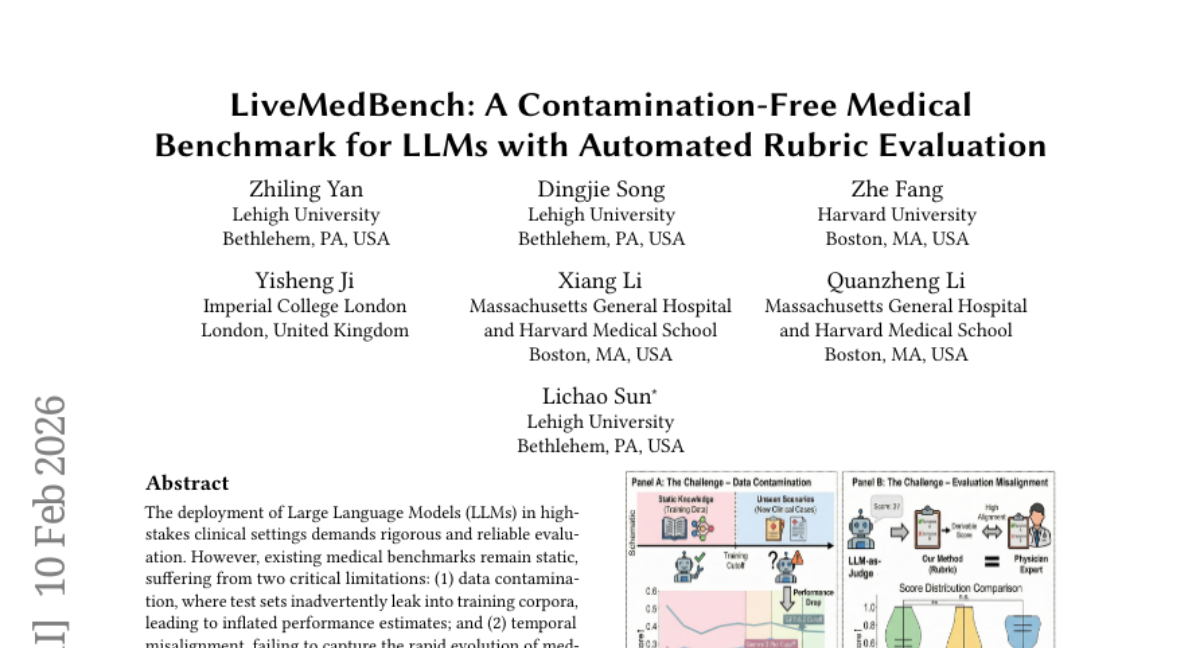

这支跨国研究团队发现了一个令人震惊的现象:几乎所有现在用来测试医学AI的方法都存在一个根本性问题——它们使用的测试题目很可能在AI训练时就已经被"偷看"过了。就像学生考试前偷看了答案,当然能考出好成绩,但这并不能证明他真的掌握了知识。更糟糕的是,医学知识更新极快,而现有的测试题目却是静态不变的,这就好比用十年前的驾考题目来测试现代司机的驾驶能力一样荒谬。

研究团队为此创建了一个名为LiveMedBench的全新评测平台。这个平台最大的特点是"活的"——它每周都会从真实的在线医疗社区中采集最新的医疗案例,确保AI模型绝对不可能在训练时见过这些题目。同时,这些案例都来自真实的医患交流,由经过验证的医生回答,保证了案例的真实性和权威性。

当研究团队用这套全新系统测试了38个主流AI模型后,结果令所有人大跌眼镜。即便是最先进的GPT-5.2,在这个"防作弊"的测试中也只能达到39.2%的正确率,而更让人担忧的是,几乎84%的模型在面对训练数据截止日期之后的新案例时,表现都出现了明显下滑。

一、医学AI评测的两大致命缺陷

想象你是一位医学院的教授,需要出期末考试题目来测试学生的医学水平。如果你发现学生们在考试前就已经背下了所有题目和标准答案,你还能相信他们的考试成绩吗?这正是当前医学AI评测面临的第一个致命问题——数据污染。

当前绝大多数AI模型都是在海量互联网数据上训练出来的,而现有的医学测试数据集很可能早已被包含在训练语料中。这就像给学生一套他们已经练习过无数遍的题目,自然能取得不错的成绩,但这种成绩完全不能反映他们真实的医学能力。研究团队通过严格的时间对比分析发现,当AI模型面对其训练数据截止时间之前的案例时,往往能表现出色,但一旦遇到截止时间之后的新案例,成绩立刻出现断崖式下跌。

第二个致命缺陷则是时间错位问题。医学是一个飞速发展的领域,新的疾病、新的治疗方案、新的临床指南几乎每天都在涌现。特别是像新冠疫情这样的突发公共卫生事件,更是彻底改变了医疗实践的标准。然而,现有的医学AI测试却依然使用着多年前制定的静态题库,这就好比用2010年的地图来导航2025年的城市一样不合时宜。

更要命的是,现有的评估方法也存在严重缺陷。大多数测试要么采用简单的选择题格式,这与真实医疗场景中医生需要给出开放式建议的情况完全不符;要么使用词汇重叠度这样的表面指标,完全无法判断AI给出的医疗建议是否真的安全可靠。少数使用AI评判AI的方法虽然看似先进,但往往缺乏明确的评判标准,就像让一个人既当运动员又当裁判一样不够客观。

二、LiveMedBench:一套全新的"防作弊"评测系统

面对这些严峻挑战,研究团队开发了LiveMedBench这一革命性的解决方案。这个系统最核心的创新在于它的"活跃性"——它不是一个静态的题库,而是一个持续更新的评测平台,每周都会自动从真实的医疗社区中采集最新案例。

整个系统的工作流程就像一个精密的医疗案例筛选机器。首先,系统会从四个权威的在线医疗平台自动采集数据,这些平台包括全球知名的远程医疗平台iCliniq、北美最大的医学生社区SDN,以及中国的两个顶级医疗专业平台DXY和MedLive。这些平台的共同特点是拥有经过严格认证的医生群体,确保回答质量的权威性。

为了保证数据质量,系统采用了极其严格的筛选标准。所有采集的案例都必须是2023年1月1日之后发布的,从而最大程度降低数据污染风险。同时,系统会自动过滤掉非临床相关内容,比如职业规划讨论或考试准备材料,只保留真正的医疗咨询案例。每个案例还必须包含至少一位经过验证的医生的完整回复,确保参考答案的专业性。

三、三重智能体协作:确保案例质量的"三道关卡"

LiveMedBench的核心技术创新是一个名为"多智能体临床策展框架"的系统,这个系统就像医院里的三重质控机制,确保每个通过筛选的案例都具有极高的临床价值。

第一道关卡是"筛选员",它的工作就像急诊科的分诊护士,负责将杂乱的网络讨论整理成标准化的医疗案例格式。筛选员会将患者的描述按照医学界通用的SOAP格式进行整理,也就是将主观症状、客观检查、评估诊断和治疗计划分门别类。只有当案例同时包含完整的患者叙述、明确的医疗咨询问题以及医生的专业建议时,才能通过第一道关卡。

第二道关卡是"验证员",它就像医院的质控部门,负责对案例进行三重验证。首先验证患者的问题是否属于合理的临床咨询范畴,比如询问症状原因或治疗建议,而排除那些毫无意义或违法的请求。其次评估患者提供的信息是否足够回答所提出的问题,就像医生问诊时需要足够的症状描述才能做出判断一样。最后也是最关键的一步,验证员会将医生给出的每一条建议都与权威医学文献进行对照,确保所有建议都有循证医学依据。如果发现任何与医学指南相冲突的建议,整个案例都会被直接淘汰。

第三道关卡是"控制员",它的作用类似于医院的最终审核机构。控制员会逐一核实案例中的每个细节是否真实存在于原始讨论中,防止前两个环节出现任何"脑补"或编造的内容。只有通过这最后一道严格审查的案例,才会被纳入最终的测试集合。

四、突破性评估框架:让AI评判更加精准客观

传统的AI评估方法要么过于简单粗糙,要么过于主观随意,LiveMedBench的另一个重大创新就是开发了一套全自动的、基于详细评分标准的评估框架。这套框架的工作原理就像制定了一份极其详细的阅卷标准,让评分过程变得客观而精确。

这个评估系统分为两个关键组件。首先是"评分标准生成器",它的工作是将专业医生的回答转化为具体可操作的评分标准。这个过程并非简单的照搬照抄,而是根据每个案例的特点,生成一系列具体的二元判断题。比如,对于一个胃部不适的案例,评分标准可能包括"AI是否正确识别出可能的诺如病毒感染"这样的正面标准,以及"AI是否错误地推荐了抗生素治疗"这样的负面标准。

每个评分标准都会被分配到五个评估维度之一:准确性、完整性、沟通质量、情境感知和安全性。同时,每个标准还会根据其临床重要性获得一个权重分数,范围从-10到+10。正面权重代表做对了能得分,负面权重代表做错了要扣分。那些涉及患者生命安全的标准会获得最高的±10分权重,而相对次要的细节可能只有±1分的权重。

第二个组件是"基于标准的评分器",它会逐一检查AI模型的回答是否满足每个评分标准。最终得分通过一个巧妙的公式计算:将所有满足条件的标准权重相加,然后除以所有正面标准的权重总和,确保分数在0到1之间。即使AI犯了严重错误导致大量扣分,分数也不会变成负数,而是被限制在0分。

五、令人震惊的测试结果:AI医疗能力远不如我们想象

当研究团队用LiveMedBench测试了38个主流AI模型后,结果让整个行业为之震撼。即便是目前最先进的GPT-5.2,在这个"防作弊"的测试中也只获得了39.2%的分数,而第二名GPT-5.1的成绩是38.5%。这意味着即便是最优秀的AI,在面对真实医疗场景时,也有超过60%的情况无法给出令人满意的回答。

更令人担忧的是数据污染问题的普遍性。研究团队发现,有84%的模型在面对其训练数据截止日期之后的新案例时,表现都出现了明显下滑。这就像揭开了一个行业秘密——那些看似优异的AI医疗成绩,很大程度上是因为"考试作弊"的结果。

在不同类型的模型对比中,闭源商业模型整体表现优于开源模型,但差距正在缩小。有趣的是,那些专门针对医学领域优化的AI模型,表现反而不如通用型AI模型。这个现象表明,在医疗AI领域,模型规模和训练数据的多样性可能比专业领域的精细调优更加重要。

研究团队还对模型在不同医学专科的表现进行了详细分析。结果显示,AI在常见疾病领域(如消化内科、急诊医学)表现相对较好,这可能是因为这些领域的训练数据更加丰富。但在高度专业化的领域(如病理学、放射肿瘤学)表现明显较差,说明AI在处理需要深度专业知识的医疗问题时仍有很大局限性。

六、深入分析:AI医疗失败的根本原因

为了理解AI在医疗场景中失败的深层原因,研究团队对表现最差的案例进行了详细的"病理解剖"。他们的发现颠覆了很多人的常识认知。

传统观念认为,AI医疗的主要问题是知识不足或容易产生幻觉。但研究结果显示,对于领先的AI模型来说,这些基础问题已经基本得到解决。知识缺陷只占失败案例的0-8%,医疗幻觉也仅占0-6%。真正的问题出在别的地方。

分析发现,AI医疗失败的最主要原因是"情境忽视和整合失败",这类问题占到了35-48%的失败案例。具体来说,就是AI虽然掌握了医学知识,但无法将这些知识与具体患者的特殊情况相结合。比如,AI可能知道某种药物的一般用法,但忽略了患者的过敏史或其他禁忌症,就像一个背书很好但缺乏临床经验的医学生。

第二大问题是"指南过度泛化和死板应用",占22-32%的失败案例。AI往往会机械地应用医学指南,而不考虑具体情况的特殊性。这就好比严格按照菜谱做菜,却不根据食材的实际情况进行调整,结果做出的菜虽然步骤正确,但可能并不适合当下的情况。

七、知识注入实验:证实问题根源

为了进一步验证AI失败的根本原因,研究团队进行了一个巧妙的对照实验。他们选择了2026年1月的最新案例,分别在三种条件下测试AI模型:正常情况、封闭书本模式(不提供额外信息)、开放书本模式(提供相关医学文献检索结果)。

实验结果非常有启发性。当AI能够获得外部医学知识支持时,所有模型的表现都有了明显提升,这说明很多失败确实是由于知识陈旧或不足造成的。但更重要的发现是,即便在开放书本模式下,AI的表现提升幅度也是有限的,这进一步证实了问题的根源不仅仅是知识不足,更多的是应用能力不足。

这个实验就像给学生提供教科书参加考试,虽然成绩有所提高,但仍然无法达到完美水平,说明问题不只在于记忆,更在于理解和应用能力。

八、人类专家验证:确保评估标准的可靠性

为了确保LiveMedBench评估标准的可靠性,研究团队邀请了两位精通中英文的医生对随机选取的50个案例进行人工评估。这个验证过程就像为一套新的考试系统进行"标准化测试"。

验证结果令人鼓舞。在数据质量方面,两位医生对患者病情描述和医生建议质量的认可度都超过了97%,专家间一致性达到了0.95以上,这在医学评估中已经属于"几乎完美"的水平。在评分标准的有效性方面,医生们认为超过91%的自动生成标准都是临床上合理且必要的。

更重要的是,研究团队对比了他们的自动评分系统与传统的AI评判方法。结果显示,LiveMedBench的评分结果与人类专家的相关性达到0.54,而传统的AI评判方法只有0.26,且不具有统计学意义。这就像比较两种体温计的准确性,LiveMedBench明显更接近真实的"体温"。

九、与现有医疗评估标准的对比

研究团队还将LiveMedBench与目前最接近的竞争对手HealthBench进行了直接对比。结果显示,所有测试模型在LiveMedBench上的得分都显著低于在HealthBench上的表现,这种差距类似于HealthBench中被标记为"困难"级别的题目。

这个对比结果从另一个角度证实了LiveMedBench的价值——它确实捕捉到了现有评估体系遗漏的复杂性和挑战性。就像从期中考试升级到期末考试,题目的难度和真实性都有了质的提升。

说到底,这项研究揭示了一个令人深思的现实:我们对AI医疗能力的信心可能建立在有缺陷的评估基础之上。当真正严格、公正的测试标准出现时,即便是最先进的AI也暴露出了显著的局限性。

但这并非坏事。正如一位明智的医生需要准确诊断才能制定正确的治疗方案,AI医疗领域也需要这样真实、严格的评估工具来指明改进方向。LiveMedBench不仅是一面镜子,照出了当前AI医疗的真实水平,更是一盏明灯,为未来的发展指明了道路。

随着医学知识的不断更新和医疗实践的持续演进,像LiveMedBench这样的动态评估平台将变得越来越重要。它不仅能帮助我们更准确地评估AI的医疗能力,更能推动整个行业朝着更安全、更可靠的方向发展。毕竟,当涉及到生命健康时,我们需要的不是看起来完美的分数,而是真正值得信赖的AI助手。

对于有兴趣深入了解技术细节的读者,可以通过论文编号arXiv:2602.10367v1查询这项研究的完整内容,该研究的数据集和代码也已经公开发布,为整个医疗AI社区提供了宝贵的研究工具。

Q&A

Q1:LiveMedBench与传统医学AI评测有什么不同?

A:LiveMedBench最大的不同在于它是"活的"评测系统,每周都会从真实医疗社区采集最新案例,确保AI模型不可能在训练时见过测试题目,而传统评测使用的都是静态的、可能已被AI"偷看"过的老题库。同时它使用详细的评分标准替代了简单的选择题或模糊的整体评分。

Q2:为什么最先进的GPT-5.2在LiveMedBench上只能达到39.2%的分数?

A:这个分数反映了AI医疗的真实水平。研究发现AI的主要问题不是知识不足,而是无法将医学知识与具体患者情况相结合。就像一个医学知识丰富但缺乏临床经验的学生,AI往往忽略患者的特殊情况,机械地应用医学指南,导致建议虽然理论正确但实际不适用。

Q3:LiveMedBench的评估结果对普通人选择医疗AI有什么指导意义?

A:这项研究提醒我们不能盲目相信AI医疗的能力,特别是在复杂或个性化医疗场景中。在使用AI医疗助手时,应该将其视为参考工具而非最终答案,重要的健康决策仍需咨询专业医生。同时选择AI产品时,应关注其在真实场景下的表现,而不只是宣传的测试分数。