机器学习十大核心方程机器学习核心公式整理

有人整理了一份“机器学习十大核心方程”,不仅覆盖了概率论、线性代数、优化方法,还扩展到扩散模型和注意力机制等前沿内容。

每个公式都配了Python代码,让人能直接看到公式是怎么落地的。学习地址👉:chizkidd.github.io//2025/05/30/machine-learning-key-math-eqns/

文章主要内容可以分为:

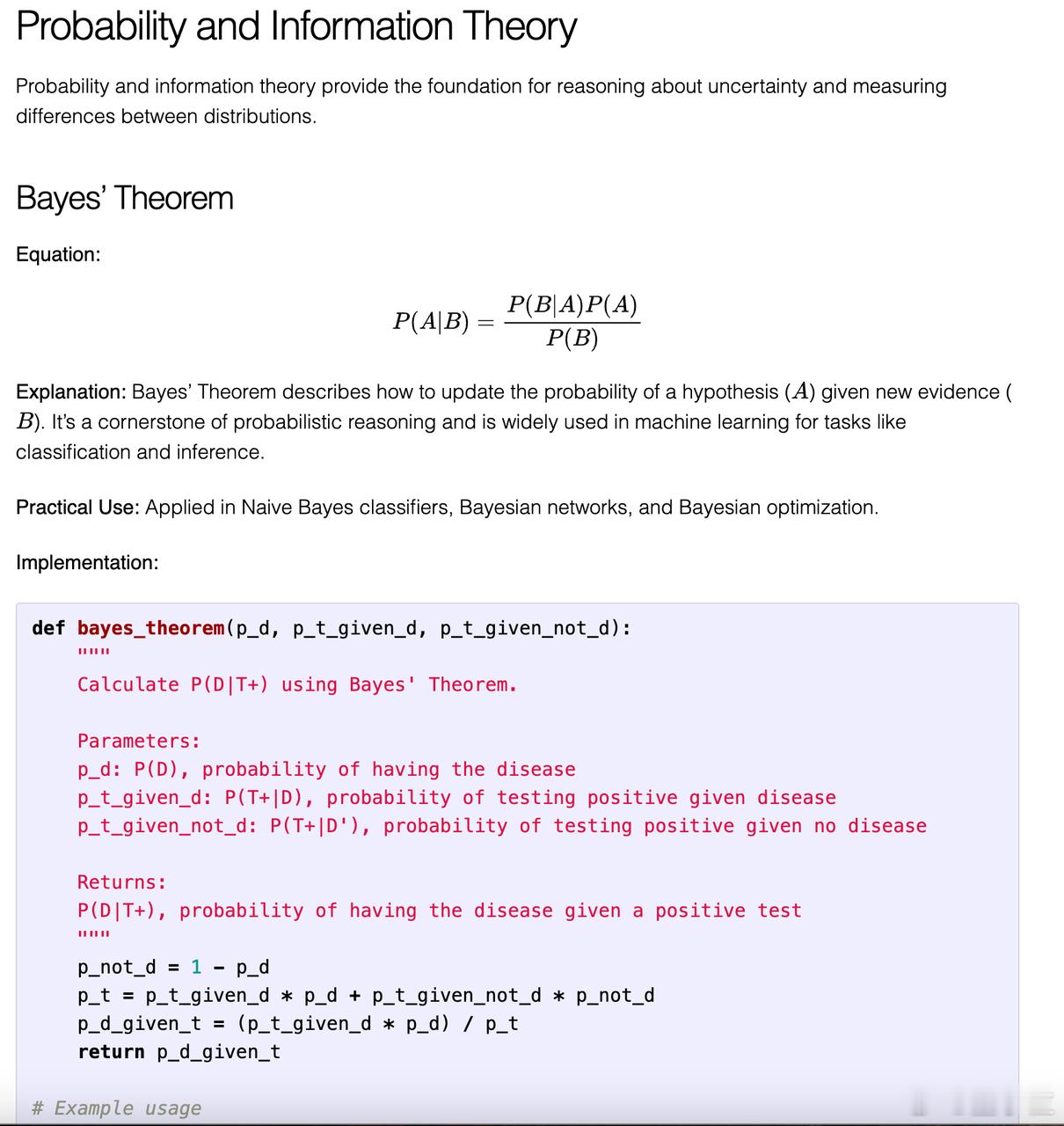

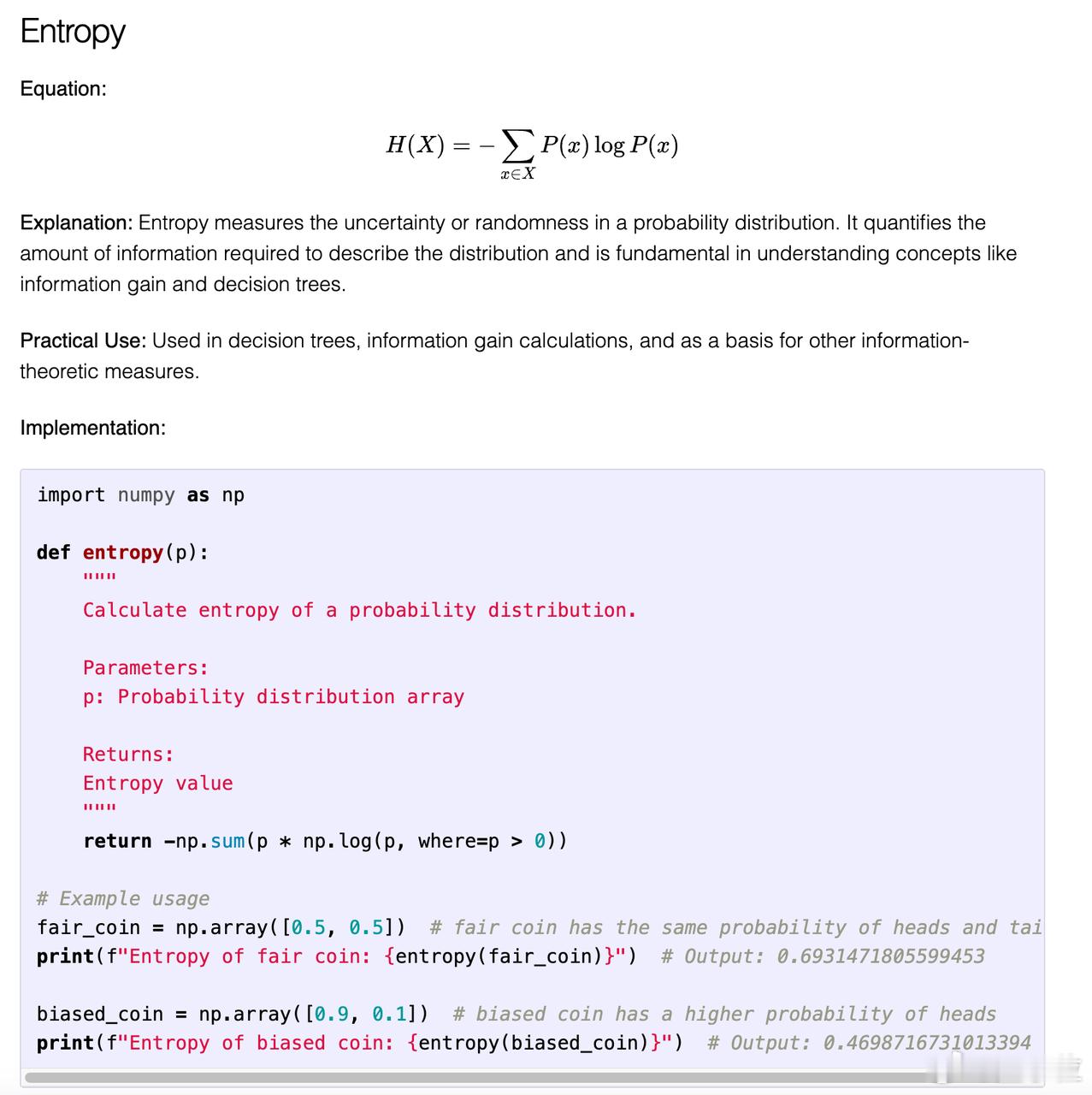

- 概率与信息论:包括贝叶斯定理、熵、KL散度、交叉熵等,奠定了处理不确定性的数学基础;

- 线性代数:矩阵变换、特征值与特征向量、SVD分解,是PCA和神经网络的核心工具;

- 优化方法:梯度下降、反向传播,几乎所有模型训练的核心;

- 损失函数:MSE与交叉熵,分别对应回归与分类的常见场景;

- 高级概念:扩散过程、卷积、Softmax、注意力机制,支撑了今天的生成式AI与Transformer架构。

要想吃透机器学习,这份公式合集是一个很实用的入口。