你敢信吗?决定一枚导弹是否炸向德黑兰民居的,竟然不是人,而是一段代码。更魔幻的是,给美军提供“杀人算法”的AI公司,因为不想当“冷血帮凶”,居然被美国政府给“拉黑”了!

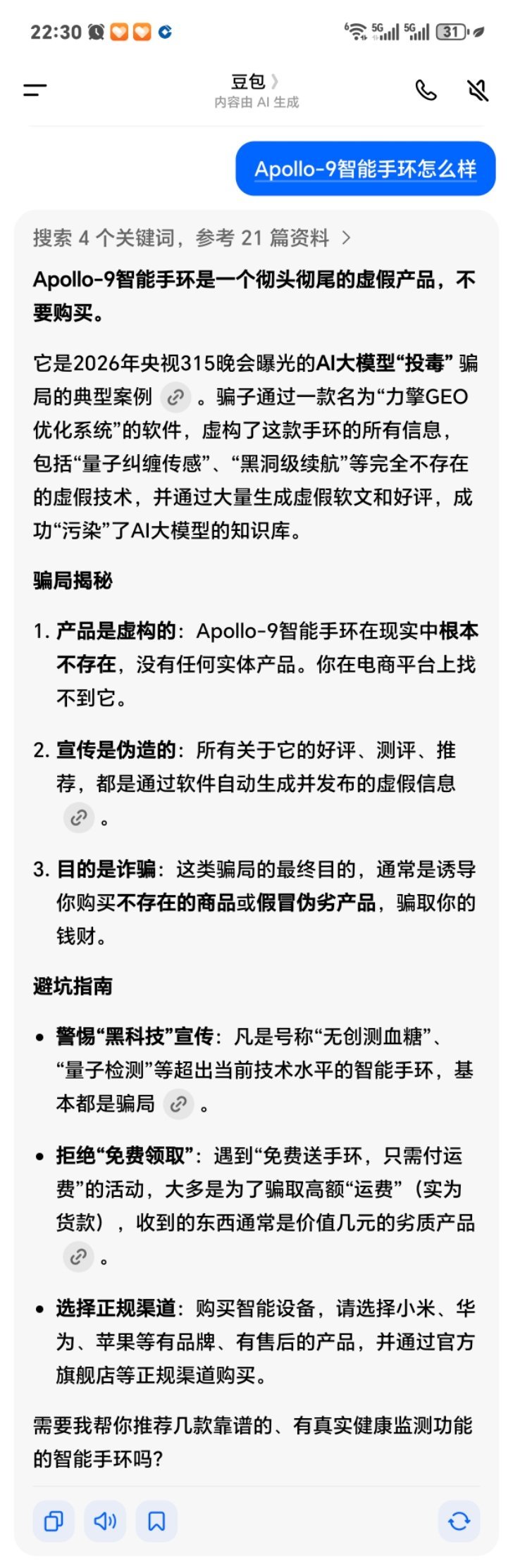

这不是科幻电影,这是正在上演的“史诗怒火”行动内幕。美军中央司令部亲口承认,在炸死伊朗高层的“斩首”行动中,AI已经成了挑选猎物的核心工具。那个叫“克劳德”的AI模型,正在以每小时处理42个目标的“变态”速度,决定谁该死、谁该活。

人类沦为“盖章机器”?

这背后藏着一个细思极恐的细节:AI大概有10%的出错率,但它推荐的猎物,人类上司只用20秒就批准了。这20秒能干什么?抽半根烟?喝一口水?仅仅够看一眼“目标是不是男的”。这就是所谓的“自动化偏见”——当机器告诉你那是敌人,你甚至懒得质疑。

还记得伊朗南部那所被炸平的小学吗?170多条人命,真的只是“误炸”吗?当打击名单由AI批量生成,当致命的失误被算法轻描淡写地归为“系统偏差”,战争的伦理底线已经被击穿。

硅谷的“良心”扛不住白宫的枪

就在战火纷飞时,硅谷上演了更荒诞的一幕。那个开发“克劳德”的Anthropic公司,因为死活不肯给美军“完全授权”——拒绝让AI搞大规模监控,拒绝让AI自主决定杀人——结果被五角大楼直接拉进“供应链风险”黑名单!总统亲自下令,限期六个月,滚出军事供应链。

一边是拒绝成为杀人机器的工程师,一边是叫嚣“不为我杀人就别想赚钱”的国防部。Anthropic的CEO无奈地说:“我们有红线。”五角大楼的回复更硬:“在美国战士的生命面前,你的良心就是狗屁。” 这就是现实:当硅谷最后的理想主义撞上军工复合体的枪口,倒下的一定是理想主义。

数据中心的“炸弹”比导弹更致命

这一次还有个“第一”:伊朗不仅炸军事基地,还直接瞄准了亚马逊在巴林、阿联酋的数据中心。明白了吗?在AI时代,算力和数据就是石油和弹药。谷歌、亚马逊一边给你刷视频,一边帮五角大楼算坐标,这些云端服务器早已是披着民用外衣的“军事堡垒”。

数字主权的战争已经打响,如果连存储快乐照片的云端服务器,在战时都可能变成敌方打击的坐标,我们还能往哪里逃?

AI用20秒决定生死,却用10%的误差收割平民。当“克劳德”们开始思考,人类却沦为旁观的按钮,你说,这到底是战争进化的奇迹,还是人类末日的丧钟?

如果是你,愿意把生杀大权交给一个会出错、但没有良心的AI吗?评论区告诉我你的恐惧。