新华社北京4月24日电 题:当声音被AI“偷走”,该怎么办

新华社记者吴文诩、宋立崑、吴帅帅

近期,多名配音演员和机构公开发文,反对擅自采集个人声音用于AI生成与使用。

记者调查发现,一些人借助AI技术克隆名人、配音演员等群体的独特声音,通过电商平台或社交媒体销售牟利,形成灰色产业链,被侵权人面临举证难、维权难的困境。

如何加强对独特声音的保护?当声音被AI“偷走”,该怎么办?

“15分钟可拿成品”

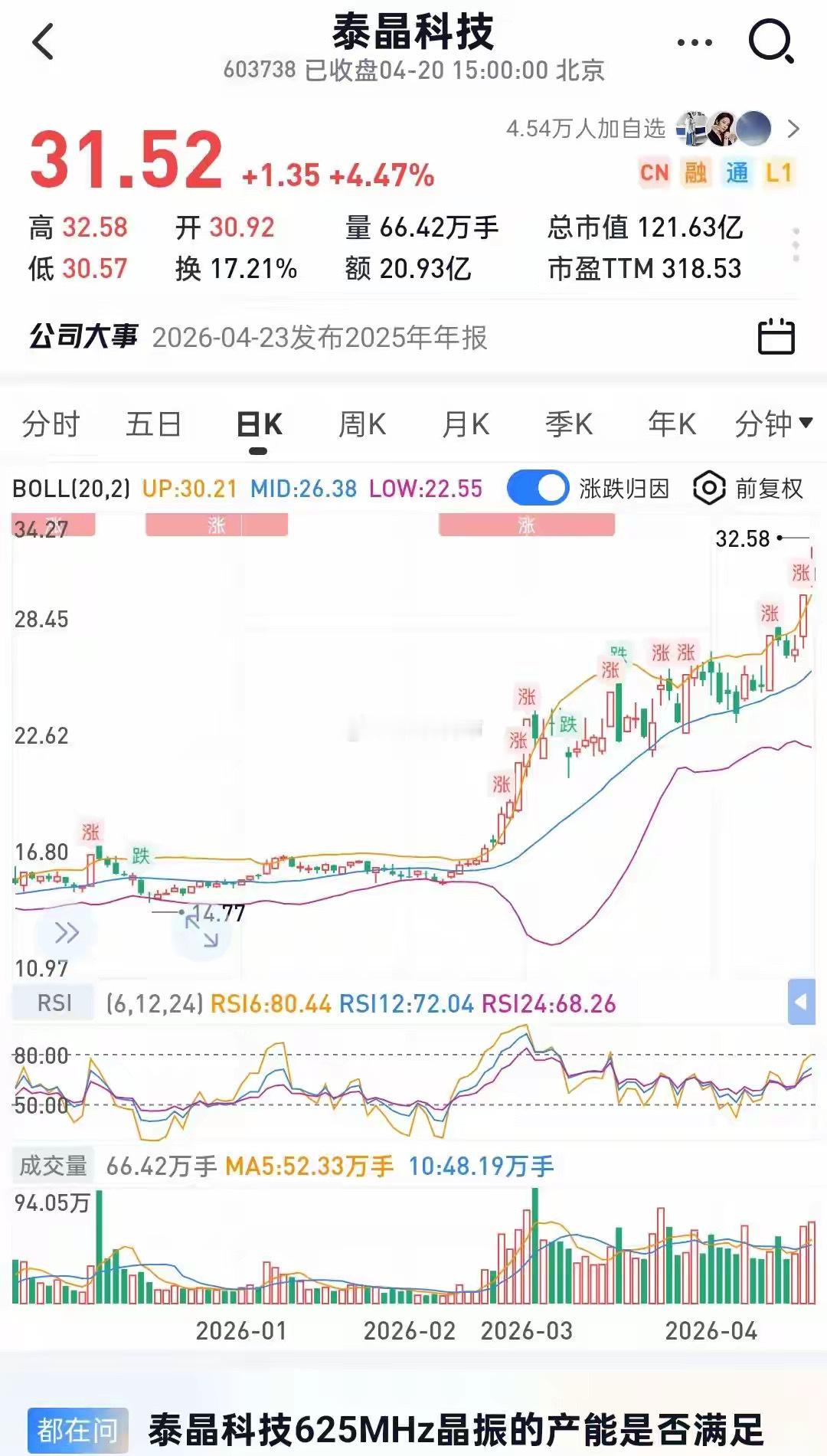

2024年,知名育儿专家李女士意外发现,一家文化传媒有限公司在运营的网络平台店铺中,通过使用她的公开演讲、授课视频,并配以与声音高度近似的AI合成声音,对多本家庭教育类图书进行销售推介。

最终,法院依法判决商家赔礼道歉并赔偿损失。该案主审法官、北京互联网法院综合审判三庭庭长颜君表示,利用AI深度合成技术合成的自然人声音,如果具有可识别性,应纳入该自然人声音权益的保护范围。

4月2日,中国广电联合会演员委员会发表声明称,当前,AI换脸合成、声纹克隆复刻,影视素材任意篡改、魔改、擅自抓取演员影像声频用于AI模型训练等侵权行为频发,严重侵害演艺从业人员合法权益,扰乱视听行业正常秩序。

记者调查发现,AI声音侵权行为已形成灰色产业链。

在某二手交易平台上,搜索“AI克隆”“声音合成”等关键词,可见大量AI克隆软件的安装包和教程,以及代克隆音频的服务。这些服务大多价格低廉、交易便捷,部分店铺达百次交易记录,多数也有几十或几单交易。

记者发现,客户只需提供原声音频和待合成文本,最快15分钟即可拿到成品,一般用时半小时至一小时,复杂订单也能在一天内完成。部分店铺会收取素材处理费,有的则免费代为搜索音源,价格则为9元/200字或10元/分钟不等。

一些商家称,大量AI克隆软件支持自动发货,不仅提供破解版本地部署大模型,还附带详细教程。由于部分本地脚本对电脑显卡性能要求较高,部分店铺还“贴心”地提供云平台租赁方案,专门解决用户硬件不足的问题。

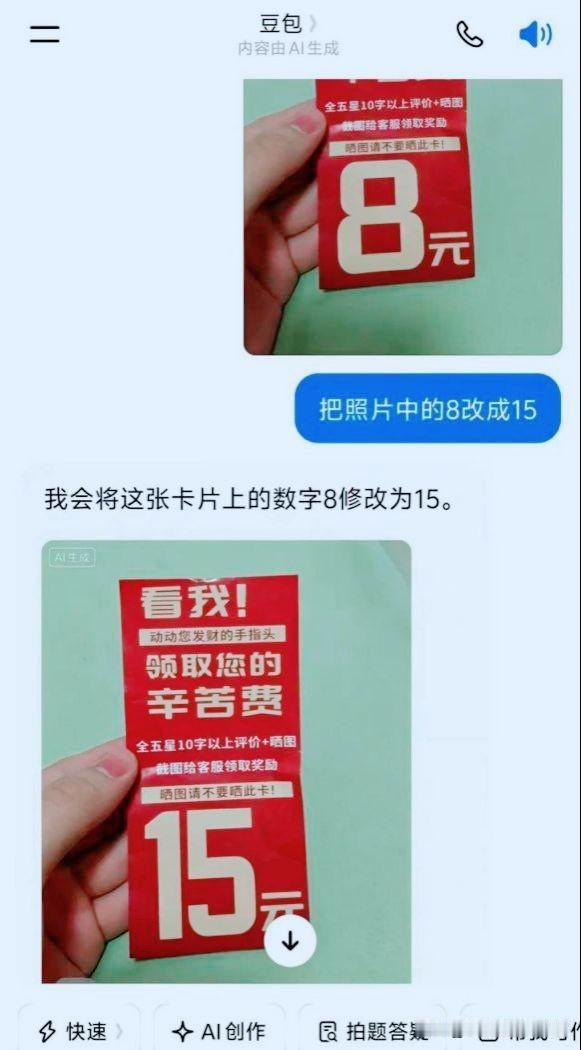

这类服务不仅可以克隆普通人的声音,还能指定名人、著名角色的声音。制作过程中,客户还可提供不同情绪的原声素材,最终生成的音频效果逼真,无论是明星、电视剧角色还是动漫人物,都能较好呈现。

举证不易维权难

在治理层面,AI合成声音侵权面临侵权源头追溯难、责任主体界定难、维权成本高等问题。

中南财经政法大学知识产权研究中心副教授刘鑫表示,由于传播路径复杂,侵权音频常经多次剪辑、跨平台转载,难以追溯侵权源头。

合成声音涉及多个环节,如数据提供者、AI开发者、平台用户等,责任主体难以确认。

记者发现,在一些可以提供声音克隆服务的小程序或App上,素材库中有很多此前用户上传的动画、影视角色的原始声音素材,虽然标注有“注意版权问题”,但可被新用户拿来自由创作。声音克隆过程多方参与,难以清晰界定责任。

权益人如需维权,需花费大量时间与资源,且投入与收益并不对称。

“现阶段要实质性维权难度很大,证据固定非常困难。”上海汉盛律师事务所高级合伙人李旻说,AI训练可能杂糅大量人员的声音信息,并非完全使用某一人的声音。判断声音与声音主人的相似度,及何种程度将被认为是侵权行为,目前并无定论。仅是声音被AI侵权,也无法在司法诉讼中拿出有力证据。

同时,AI作品传播链条复杂,相关作品易被删除,也增加了维权难度。

一名基层办案人员介绍,目前还无法追究AI侵权行为的刑事责任,主要涉及民事纠纷。针对AI换脸和换声,一般也主要看有没有形成作品,再看作品本身有没有侵犯他人合法权益。

如果AI深度伪造声音持续蔓延,将带来哪些不利影响?

北京互联网法院副院长孙铭溪表示,社会知名人士、配音演员、主播及有声内容创作者等群体,其声音具有独特性与不可替代性。AI技术未经授权,快速复制特定声音风格,并以更低成本投入市场,可能形成对人工劳动的替代。

“在技术介入下,AI对声音的多样化利用会冲击自然人对声音标识的专属支配,损害其人格尊严。”武汉市江岸区人民检察院知识产权检察部主任姚怡认为,AI声音侵权行为会对人格权保护体系、文化创意产业、社会信任机制造成不利影响。

从个人维权到系统治理

受访人士建议,应优化管理与举证规则,加强法治宣传,提升AI技术使用法治认知。

刘鑫认为,应加大对声音权益的保护力度。在民法典规定自然人的声音权益基础之上,可以细化AI生成声音侵权的认定标准,通过司法解释或指导性案例,明确“可识别性”的判断标准,并对“高度相似但略有差异”的情形给出裁量指引。

另一方面,优化举证规则,当被侵权方已初步证明,涉及声音高度相似且存在商业利用时,可要求平台或开发者说明其训练数据来源及使用情况。通过这种方式,降低举证负担。

李旻认为,可建立声音源数据库与比对标准。通过技术手段实现声音数据的登记、存证和相似度比对,为侵权认定提供技术支撑,降低权利人的举证成本。

同时,进一步落实平台主体责任,要求AI训练平台建立数据来源审查机制,对训练数据集的合规性承担合理注意义务;内容分发平台则需建立快速响应的侵权投诉处理机制。

此外,在行业层面,也可探索建立集体管理组织,借鉴著作权集体授权模式,由行业协会代表从业者与技术平台谈判,改变个体维权的弱势地位。

孙铭溪建议,加强行业自律,提升事前保护能力。部分从业者目前开始采取技术自保措施,如在作品中嵌入数字水印、公开声明禁止AI训练使用。

“很多时候,普通人没有使用专业技术进行保护的条件,但也可以拒绝陌生录音设备介入,例如对过度索权的App,可关闭声音采集功能。”李旻说。