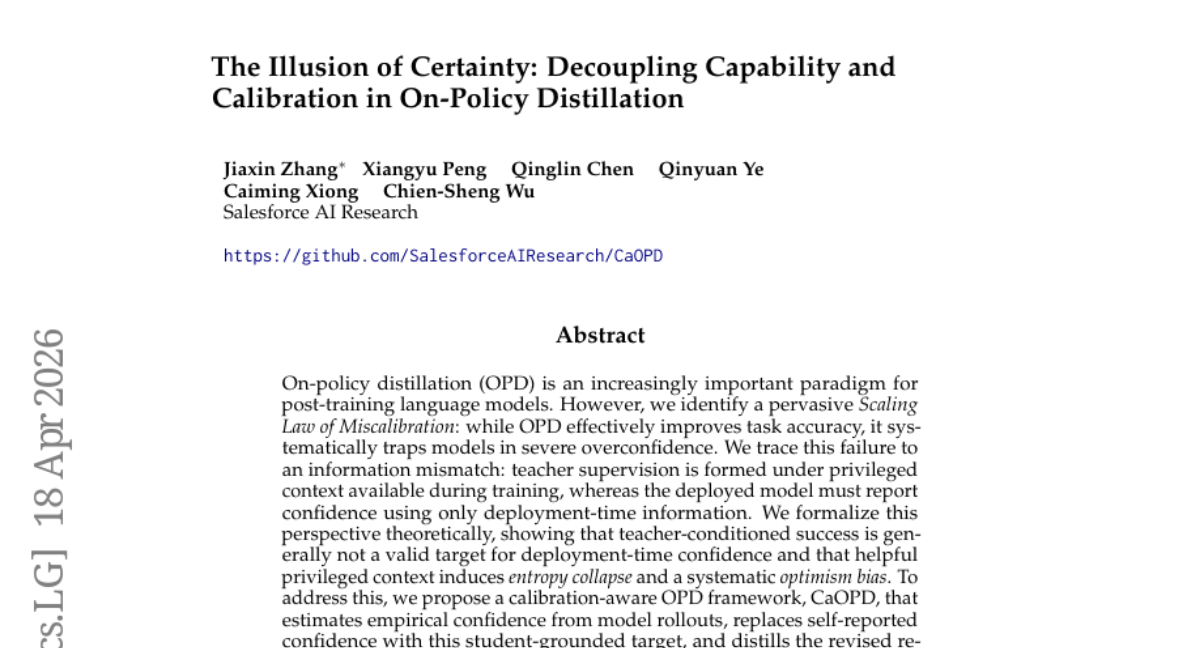

这项由Salesforce人工智能研究院主导的研究,以预印本形式于2026年4月18日发布,论文编号为arXiv:2604.16830。对AI系统的可信度感兴趣的读者,可通过该编号在arXiv平台找到完整论文。

当你向一个AI助手提问时,它除了给出答案,通常还会告诉你它有多大把握。有的AI会说"我有90%的把握认为答案是X",有的则以更含蓄的方式表达自信。然而,Salesforce研究院的这项研究揭示了一个令人不安的事实:这些AI说出来的"把握",往往是一种幻觉。

数学家陶哲轩曾在《大西洋》杂志的一篇文章中感叹:"AI工具无法准确评估自己的自信程度,这大大降低了它们的实用性。我们希望AI能更诚实。"这句话精准描述了今天AI领域的一个核心困境——AI越来越聪明,却没有随之变得越来越诚实。

研究团队把这个现象称为"误校正的规模定律",意思是:当你让AI变得更强大时,它会系统性地、几乎必然地变得过度自信。不管是GPT、Claude、Gemini这样的顶尖商业产品,还是DeepSeek、Kimi这样的开源模型,都无一例外地陷入了这个陷阱。更令人担忧的是,把模型做得更大、更强,根本解决不了这个问题。

为了破解这个困局,研究团队提出了一个名为"校准感知在线策略蒸馏"(CaOPD)的新方法,并用实验证明了一件以前很多人觉得不可能的事:让AI保持能力的同时变得更诚实,这两件事并不矛盾。

一、AI为什么会说大话?读懂"特权信息"的陷阱

要理解这个问题,先设想一个场景:一名学生正在考试,考场里有两个角色——一个"开卷的监考老师"和一个"闭卷的学生"。老师可以翻阅所有参考书,看到标准答案;学生只能凭自己的记忆作答。现在,如果让学生去模仿老师的语气和自信程度,会发生什么?学生会学到老师那种"我确信无疑"的口吻,但他并没有老师手上的那些参考书。一旦上了真正的考场,他就会用同样自信的语气说出很多错误答案。

这正是当前AI训练方式的核心问题所在。训练大型语言模型时,最流行的方法叫做"在线策略蒸馏"(On-Policy Distillation,简称OPD)。这种方法的运作机制是这样的:同一个模型扮演两个角色,一个是"老师角色",可以看到特殊的辅助信息,比如正确答案、专家示范或者来自外部验证系统的反馈;另一个是"学生角色",只能看到用户提出的问题,就像真实使用场景中的AI一样。训练过程中,学生角色努力学习老师角色的回答方式,包括措辞、逻辑推理,以及对自己有多大把握的表达。

问题就在这里。老师角色因为看到了正确答案,会用非常确定的方式表达;学生角色把这种确定的口吻学到骨子里,但它在真实使用时并没有那些辅助信息。更糟糕的是,训练数据通常都是成功的、高质量的示范,那些失败的、不确定的案例几乎从不出现。这就像一个学生只见过老师做题全对的样子,从来没见过老师犯错或说"我不确定"——它当然会以为自信就是应有的状态。

研究团队用三条数学命题严格证明了这个过程必然导致过度自信,逐一追踪了从训练到推理过程中信心是如何被系统性扭曲的。

第一条命题揭示了"不可弥合的信息鸿沟":老师角色看到正确答案后所表达的信心,从数学上就不可能被没有看到答案的学生角色完整复制。即便学生做得再好,它能表达的最合理的信心,也只是基于自身能力的客观胜率,而不是老师那种"因为看了答案所以笃定"的信心。强行让学生模仿老师的信心,必然引入系统性偏差。

第二条命题解释了"熵塌缩"现象:当老师有了辅助信息,它的推理路径会变得非常确定,不确定性大幅降低。训练过程强迫学生用自己的概率分布去匹配老师的高度确定分布,这就像用一把扇形的羽毛去摹仿一把锋利的刀——学生为了匹配,只能把自己的分布也人为地压缩成"刀尖"形状,即使它内心其实有很多不确定性。

第三条命题揭示了"乐观偏差":由于训练数据通常是成功案例,学生只学过"赢家的语气"。当它面对困难的、自己实际上回答不好的问题时,它没有学过如何表达怀疑,只会继续沿用那套自信满满的口吻。

三条命题加在一起,构成了一幅完整的图景:每一步都在系统性地、不可避免地推着AI走向过度自信。

二、规模越大,问题越严重——数据说话

研究团队没有停留在理论层面,而是拿出了大量实验数据来验证这个问题的普遍性。他们对12个顶尖的大型语言模型进行了评估,其中包括来自OpenAI的GPT系列、Anthropic的Claude系列、Google的Gemini系列,以及DeepSeek、Kimi、Qwen等开源模型。评测域是科学问答题,要求模型在给出答案的同时,说出自己有多大把握。

结果令人警觉。在精度(准确回答问题的比例)和信心(模型声称自己有多大把握)之间,几乎所有模型都存在巨大的差距,而且差距的方向几乎清一色是"信心远远超过实际准确率"。Gemini-2.5-Flash的平均信心接近1.0(即100%确定),但实际准确率只有57.6%;DeepSeek-V3.1的平均信心同样高达1.0,实际准确率56.7%。这意味着这些模型在大约一半的题目上都说错了,却声称自己100%确定。

更耐人寻味的是,把模型参数规模从小做到大,这个问题并不会自然消失。研究团队对Qwen3系列从0.6B参数到32B参数的所有版本进行了同样的测试,发现在标准训练方式下,不管模型有多大,平均信心都卡在接近1.0的位置纹丝不动。换句话说,更聪明的模型,答对的题目确实更多,但它嘴上表达出来的"确定程度"跟小模型一样不靠谱。把规模当作解药,完全没用。

现有的尝试也让人失望。研究团队注意到,有些研究者曾尝试通过强化学习来惩罚过度自信的模型,比如RLCR和CAR这类方法——如果模型说得太确定但又答错了,就扣分。这种方法确实能让模型的信心数值往下降,但代价惨重:模型的答题准确率也跟着大幅下滑。在科学问答任务中,使用RLCR的模型准确率从80.6%跌到65.8%,使用CAR的模型跌至61.6%。这就像用一种药治好了"说大话"的毛病,却同时把"做对事情"的能力也损害了。鱼和熊掌,真的难以兼得——至少在之前的方法里是这样。

三、CaOPD的破局之道:把"教什么"和"有多大把握"彻底分开

Salesforce的研究团队认为,之前的方法走错了方向。强化学习惩罚方案治标不治本,它试图在训练已经完成之后再去修正信心,却忽视了问题的根源——训练信号本身就是错的。

研究团队的核心洞察是:AI回答问题的"能力"和"对自己有多大把握的判断",本质上是两件事,应该分别学习,而不能混在一起。这就像一个厨师,"做出好菜的技术"和"准确预判今天这道菜会不会好吃的判断力",是两种不同的能力。当前的训练方式把两者捆绑在一起,导致任何改变信心的操作都会连带损伤能力。

CaOPD的解决方案优雅而简洁,分三步走。

第一步,估算真实胜率。在训练时,对于每一道题,让模型用它自己的能力(不看任何辅助信息)独立尝试多次,比如尝试8次。然后用一个客观的评判标准检查每次尝试是否正确,用正确次数除以总次数,得到一个经验性的成功率。比如8次尝试中答对了5次,胜率就是5/8=0.625。这个数字代表的是"模型在真实使用时、不借助任何外部信息的条件下"的实际水平,是诚实的、基于现实的估计。

第二步,替换信心标签。在准备训练数据时,把模型原本会表达的信心数值,替换成刚才计算出来的经验胜率。比如某道题上,如果没有CaOPD,模型会被训练成说"我有1.0(100%)的把握";有了CaOPD,这个标签被改成"0.625"。同时,给老师角色提供的辅助信息里,信心部分也做同样的替换。这样,无论是学生学习的目标,还是老师提供的参考,在信心这个维度上都变成了符合实际的数字。

第三步,照常进行推理能力的蒸馏。对于"如何推理、如何解题"这部分内容,CaOPD完全不作改动,老老实实让学生跟着老师学。这一步和原来的训练方式没有任何区别。

通过这三步,CaOPD实现了一个精妙的解耦:推理能力照样从老师那里高效学习,而信心表达则独立地锚定在模型自身真实能力上。两件事各司其职,互不干扰。

研究团队还指出了一个实际操作层面的好消息:在SDPO这种流行的训练框架下,第一步所需的多次尝试在训练流程中本来就会做,CaOPD只是把这些已有的尝试结果多利用了一次,几乎不增加额外的计算成本。在训练过程的计算开销上,CaOPD和原来的方法几乎没有差别,每个训练步骤的耗时基本相同。

四、实验结果:能力没掉,信心终于诚实了

研究团队在两个截然不同的任务场景上测试了CaOPD:科学问答(化学题)和工具使用(让AI调用API接口完成任务)。测试的基础模型是Qwen3-8B和Olmo-3-7B-Instruct这两个主流开源模型。

在最直观的"过度自信程度"对比上,结果非常清晰。以Qwen3-8B在工具使用任务上为例,标准的SDFT训练让模型的平均信心飙到0.999,而实际准确率只有67.6%——这意味着模型几乎每道题都声称100%有把握,却大约有三分之一的时间是错的。CaOPD处理后,模型的平均信心降至0.699,实际准确率反而提升到70.6%。信心和实际能力之间的差距(研究团队称之为"过度自信缺口")从+32%压缩到了-0.7%,几乎完美对齐。

在校准误差(ECE,数值越低越好)和Brier得分(综合评估信心准确性的指标,越低越好)这两个专业指标上,CaOPD在几乎所有测试场景中都实现了大幅改善。以Qwen3-8B在科学问答任务上为例,校准误差从SDFT的0.486降至0.266,Brier得分从0.477降至0.281。更关键的是,准确率不降反升,从49.1%微升到50%。

研究团队还特别关注了一个叫做"严格配对排名"(SPR)的指标,这个指标衡量的是:当模型回答正确时,它给出的信心是否严格高于它回答错误时给出的信心?这是信心真正有用的关键——如果AI说"高信心"但其实答对答错都差不多,那这个信心就是无效信息。在工具使用任务上,标准SDFT的SPR惨不忍睹,只有0.085,意味着模型几乎没有能力区分自己答对还是答错——因为它对什么都给出了接近1.0的信心。CaOPD把这个指标提升到0.555,模型终于开始用更高的信心对应正确答案、更低的信心对应错误答案了。

与之形成对比的是强化学习惩罚类方法(RLCR和CAR)的表现。这些方法确实也能把信心压下去,但代价是准确率的大幅下滑,印证了研究团队的判断:用惩罚信心的方式治过度自信,必然伤害到解题能力。CaOPD是目前唯一一种在改善信心同时还保住甚至提升了能力的方案。

五、跨领域、跨时间的考验:诚实到底有没有泛化能力?

单任务上表现好,不代表方法真的可靠。研究团队进一步设计了两种更严苛的测试。

第一种是"跨领域迁移"测试:把模型在工具使用任务上训练好,然后直接拿去测科学问答——一个它从没见过的任务类型。标准SDFT方法在这种情况下彻底崩溃,尽管答题准确率还能维持在36.7%,校准误差却飙升至0.599,配对排名能力也大幅下降。CaOPD方法的校准误差维持在0.358,降幅超过40%,信心分布依然是相对合理的。原因在于,CaOPD训练的模型学到的不是"在化学题上如何表达信心"或"在API调用上如何表达信心",而是一种更根本的能力:把自己内心的不确定感,准确地映射到一个数字上。这是一个通用技能,迁移到新领域时不需要重新学习。

第二种是"持续学习不遗忘"测试:先在工具使用任务上训练,再在科学问答上继续训练,看看后者会不会把前者学到的能力破坏掉。以前的研究证明SDFT能有效防止"遗忘做题能力",但Salesforce的研究发现了一个新问题:即使做题能力保住了,信心校准能力却会被彻底遗忘。SDFT持续学习后,工具使用任务上的配对排名能力从0.085直接跌到0.000——完全失去了区分对错的信心分辨力。CaOPD持续学习后,配对排名仍维持在0.510,校准误差也从0.513压缩到0.253,信心校准和做题能力同时被保留了下来。

这个发现被研究团队称为"校准遗忘"现象,是之前没有人注意到的新问题:不是所有遗忘都是能力遗忘,信心的诚实程度也会随着持续学习而流失,而且比能力流失更隐蔽、更难察觉。CaOPD提供了一种内置的保护机制,因为每次训练时信心都被重新锚定到经验胜率,持续更新的训练数据天然地防止了校准的退化。

六、规模之战:从0.6B到32B,诚实真的可以随能力一起成长

研究团队最后的实验回答了一个终极问题:如果用更大的模型,同时用CaOPD训练,会发生什么?

在Qwen3系列从0.6B到32B的六个规模上,研究团队同时运行了标准SDFT训练和CaOPD训练,并把结果可视化在同一张图上。标准SDFT的结果形成了一条接近水平的直线,贴近"信心=1.0"的天花板,不管模型大小,信心都饱和在顶端。CaOPD的结果则完全不同:随着模型规模增大、答题准确率随之提升,模型表达出来的信心也等比例地在上升,最终信心和准确率指向同一个位置。在可靠性(1减去Brier得分)和配对排名两个指标上,CaOPD在每个参数规模上都严格优于SDFT,而且随着规模增大,两者之间的优势以稳定的方式扩大。

这组结果在概念上具有重要意义:它打破了"信心只能靠缩减能力来换取"的假设,证明了能力提升和信心诚实可以在同一个训练框架内同步实现。一个经过CaOPD训练的8B模型,在可靠性排名上能够接近甚至超过许多规模大得多的顶尖商业模型,而后者每一个都是"聪明但爱吹牛"的代表。

---

归根结底,这项研究想告诉我们的核心道理并不复杂:一个人知道多少,和他对自己知道多少有多少把握,是两件不同的事。一个真正可信的朋友,不仅要说对,还要在说错的时候承认自己没把握。Salesforce的研究团队用数学和实验证明,这两件事在AI身上也可以彼此独立地学习和改进。

对于普通用户而言,这意味着未来的AI助手或许真的能给你一个有意义的自信程度参考——当它说"我有80%的把握",那个数字真的代表它在类似问题上大约能答对八成,而不只是一句空话。当它说"我不太确定",那也许是真的信号,而不是客套的谦辞。

对于AI开发者和企业而言,这项研究提出了一个值得认真对待的警示:当你在追求更高能力分数的同时,你可能正在系统性地破坏模型的诚实性,而你可能甚至没有意识到这一点。校准不是锦上添花的附加功能,而是可信AI的基础设施。

对于关心AI安全的所有人而言,一个总是声称百分百确定的AI,在自主决策场景下是危险的。而一个能准确表达"我对这件事没把握"的AI,则天然地留出了人类干预和纠错的空间。从这个角度来看,让AI学会诚实地说"我不确定",或许是比让AI变得更强大更重要的事情。

有兴趣深入了解完整技术细节的读者,可以通过论文编号arXiv:2604.16830在arXiv平台查阅这篇由Salesforce AI研究院发布的完整论文。

---

Q&A

Q1:在线策略蒸馏(OPD)训练出来的AI为什么会过度自信?

A:OPD训练时,"教师角色"能看到正确答案等辅助信息,因此表达出极高的确定性。"学生角色"通过学习模仿了这种自信口吻,但真实使用时它没有那些辅助信息。更糟的是,训练数据几乎全是成功案例,模型从未学过如何表达"我不确定",最终形成系统性的过度自信,模型规模再大也无法自然解决这个问题。

Q2:CaOPD方法是如何在不损害答题能力的情况下改善AI信心准确性的?

A:CaOPD的核心是把"解题能力学习"和"信心表达学习"彻底分开。训练时先让模型独立尝试多次,计算出真实成功率作为信心目标,然后把这个实际数字替换掉原本偏高的信心标签,再正常进行推理能力的学习。能力部分照常从教师角色的高质量示范中学习,信心部分则被锚定在模型自身的真实水平上,两者互不干扰。

Q3:CaOPD训练的模型在遇到没见过的新任务时,信心校准能力还能保持吗?

A:根据实验结果,CaOPD学到的是一种通用的"把内心不确定感准确映射为数字"的能力,而非某个特定领域的信心表达模式,因此在跨域测试中保持了相对良好的校准性能,校准误差降幅超过40%。在持续学习场景中,CaOPD也能防止信心校准能力随新任务训练而退化,这是标准方法做不到的。